Introducción a FastMCP: Conectando Scripts de Python con IA en 2026

Desarrollo desarrollo, fastmcp, IA, python1. Introducción: Desbloqueando el Potencial de la IA con Python

En 2026, la Inteligencia Artificial (IA) y los Grandes Modelos de Lenguaje (LLMs ó Large Language Models) están transformando la interacción con la información, la generación de contenido y la automatización de tareas. El verdadero potencial de estas herramientas se alcanza al integrarlas fluidamente con sistemas externos y lógica personalizada. FastMCP surge como una solución clave para 2026, actuando como un puente robusto y estandarizado entre la inteligencia de los LLMs y la capacidad de ejecución de scripts de Python, permitiendo a las aplicaciones de IA operar con una conciencia del mundo real sin precedentes.

2. El Problema: Limitaciones Intrínsecas de los LLMs Aislados

Los LLMs, a pesar de su capacidad para comprender y generar texto, presentan limitaciones fundamentales cuando operan de forma aislada:

- Conocimiento Estático: Su conocimiento se basa en datos históricos hasta su último entrenamiento, careciendo de acceso a información en tiempo real (clima, bolsa, bases de datos empresariales) o la capacidad de ejecutar acciones y consultar sistemas dinámicos.

- Falta de Interacción: Son incapaces de interactuar directamente con el mundo exterior, como llamar a APIs REST, consultar bases de datos, ejecutar comandos del sistema operativo, manipular archivos o invocar scripts de Python personalizados.

- Desarrollo Complejo: Superar estas limitaciones históricamente requería soluciones ad-hoc y personalizadas para cada integración con APIs o servicios, aumentando la complejidad, los tiempos de implementación y la probabilidad de errores.

- Contexto Limitado: Aunque manejan bien el contexto conversacional, tienen dificultades para incorporar nuevo contexto o realizar acciones fuera de su “cerebro” pre-entrenado sin mecanismos explícitos para buscar o generar información a través de lógica externa.

Estas limitaciones crean una necesidad de un mecanismo estándar y eficiente para que los LLMs puedan “actuar” y “aprender” de su entorno en tiempo real.

3. El Protocolo de Contexto del Modelo (MCP): El Lenguaje Universal para la IA

El Protocolo de Contexto del Modelo (MCP ó Model Context Protocol en inglés) es el lenguaje estandarizado que permite a una IA entender y usar funciones de Python. Funciona como un “puerto USB-C para la IA”, un estándar universal para la comunicación fluida y bidireccional entre LLMs y sistemas/servicios externos.

Propósito y Beneficios Clave:

- Capacidades Mejoradas: Permite a los LLMs acceder a datos en tiempo real, interactuar con herramientas sofisticadas e integrarse en flujos de trabajo complejos.

- Interoperabilidad: Fomenta un ecosistema de IA cohesivo al permitir la comunicación fluida entre diferentes aplicaciones de IA, modelos y servicios externos sin adaptaciones personalizadas.

- IA Dinámica y Consciente del Contexto: Transforma los LLMs en agentes dinámicos y proactivos que pueden recuperar información actual, realizar acciones y mantener un estado del mundo real.

- Reducción de la Complejidad del Desarrollo: Estandariza la provisión de herramientas y contexto a los LLMs, eliminando la necesidad de integraciones personalizadas complejas.

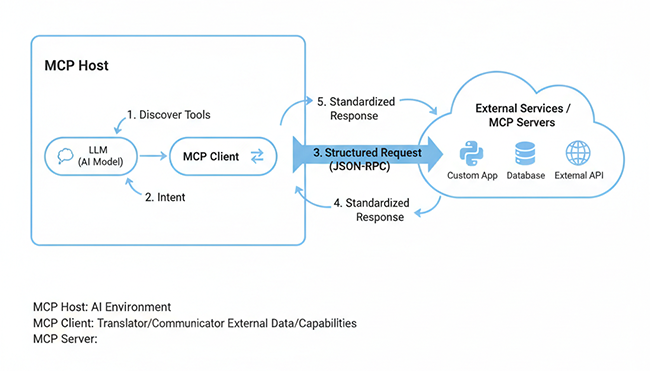

Arquitectura Cliente-Servidor de MCP:

- MCP Host: La aplicación o entorno de IA principal que alberga el LLM.

- MCP Client: Reside dentro del MCP Host, facilitando la comunicación entre el LLM y los servidores MCP externos. Traduce intenciones del LLM a solicitudes estructuradas y viceversa.

- MCP Server: Servicios externos que proporcionan contexto, datos o capacidades específicas (ej. una aplicación Python con funciones personalizadas, una base de datos, una API externa).

- Intercambio de Información: El LLM (a través del MCP Client) descubre herramientas en los MCP Servers. Cuando necesita realizar una acción o acceder a datos, envía una solicitud estructurada (ej. JSON-RPC 2.0) al MCP Server apropiado, que ejecuta la lógica y devuelve una respuesta estandarizada.

4. FastMCP: Potenciando tus Scripts de Python para la IA

FastMCP es la implementación definitiva para desarrolladores de Python que buscan aprovechar el MCP. Es un framework y SDK de Python que simplifica la implementación del MCP, abstrayendo detalles de bajo nivel y permitiendo al desarrollador centrarse en la lógica de la aplicación.

¿Qué es FastMCP?

FastMCP es el puente intuitivo y potente que conecta scripts de Python con LLMs compatibles con MCP, permitiendo que las funciones de Python se conviertan en “superpoderes” invocables por un LLM.

Principales Capacidades Expuestas a los LLMs:

- Tools (Herramientas): Funciones de Python estándar que un LLM puede llamar para ejecutar operaciones o acciones específicas (ej. consultar base de datos, enviar email, realizar cálculos, interactuar con APIs).

- Resources (Recursos): Endpoints de datos que permiten a los LLMs cargar información específica en su contexto (ej. documentos, configuraciones, estado actual de un sistema).

- Prompts (Mensajes): Plantillas de mensajes reutilizables y parametrizadas que guían la interacción del LLM, asegurando coherencia y eficiencia.

Características Clave de FastMCP:

- Facilidad de Uso con Decoradores: Transformación de funciones de Python en herramientas, recursos o *prompts* MCP con decoradores como

@mcp.tool(). - Documentación Automática: Utiliza *docstrings* y *type hints* para generar descripciones ricas y esquemas para que los LLMs entiendan el uso de las funciones.

- Validación y Conversión de Tipos: Maneja automáticamente la validación de parámetros de entrada y la conversión de tipos.

- Modos de Transporte: Soporte para STDIO, SSE (Server-Sent Events) y HTTP en streaming para flexibilidad en despliegue y comunicación.

- Ecosistema Completo: Incluye herramientas para autenticación, despliegue, pruebas y librerías cliente.

- Versiones: FastMCP 2.0 se presenta como el framework maduro y listo para producción.

5. Manos a la Obra: Conectando Python y la IA con FastMCP

La conexión de scripts de Python con IA usando FastMCP es sencilla:

Instalación:

pip install fastmcp

pip install httpx

Ejemplo 1: Función Simple de Suma (calculator_mcp.py)

from fastmcp import FastMCP

mcp = FastMCP("Calculator Demo")

@mcp.tool()

def add(a: int, b: int) -> int:

"""

Suma dos números enteros y devuelve el resultado.

Utiliza esta herramienta cuando necesites realizar una adición simple.

Args:

a: El primer número entero.

b: El segundo número entero.

Returns:

La suma de 'a' y 'b'.

"""

return a + b

if __name__ == "__main__":

mcp.run() # Ejecuta el servidor FastMCP

Explicación: FastMCP se inicializa, @mcp.tool() expone la función add como herramienta, y los *docstrings* y *type hints* proporcionan metadatos para el LLM. mcp.run() inicia el servidor.

Ejemplo 2: Herramienta de Consulta de Clima en Tiempo Real (weather_mcp.py)

from fastmcp import FastMCP

import httpx

import asyncio

mcp = FastMCP(name="WeatherAdvisor")

@mcp.tool()

async def get_current_weather(latitude: float, longitude: float) -> str:

"""

Obtiene el clima actual para una ubicación geográfica específica.

Utiliza esta herramienta cuando se pregunte por el clima actual en una ubicación.

Args:

latitude: La latitud de la ubicación (ej. 40.71).

longitude: La longitud de la ubicación (ej. -74.00).

Returns:

Una cadena que describe el clima actual y la temperatura.

"""

url = f"https://api.open-meteo.com/v1/forecast?latitude={latitude}&longitude={longitude}¤t_weather=true&temperature_unit=celsius&windspeed_unit=kmh&precipitation_unit=mm"

async with httpx.AsyncClient() as client:

response = await client.get(url)

response.raise_for_status()

data = response.json()

if "current_weather" in data:

weather = data["current_weather"]

temperature = weather["temperature"]

windspeed = weather["windspeed"]

description = f"El clima actual es {temperature}°C con vientos de {windspeed} km/h."

return description

return "No se pudo obtener el clima actual para la ubicación especificada."

@mcp.tool()

async def get_forecast(latitude: float, longitude: float, days: int = 1) -> str:

"""

Obtiene el pronóstico del tiempo para una ubicación geográfica específica para un número de días.

Útil para preguntas como '¿Cuál será el clima mañana en París?'

Args:

latitude: La latitud de la ubicación.

longitude: La longitud de la ubicación.

days: El número de días para el pronóstico (por defecto es 1, máximo 16).

Returns:

Una cadena que contiene el pronóstico del tiempo.

"""

if days < 1 or days > 16:

return "El pronóstico está limitado a entre 1 y 16 días."

url = f"https://api.open-meteo.com/v1/forecast?latitude={latitude}&longitude={longitude}&daily=temperature_2m_max,temperature_2m_min,precipitation_sum&timezone=auto&forecast_days={days}"

async with httpx.AsyncClient() as client:

response = await client.get(url)

response.raise_for_status()

data = response.json()

if "daily" in data:

forecast_text = []

for i in range(days):

date = data["daily"]["time"][i]

max_temp = data["daily"]["temperature_2m_max"][i]

min_temp = data["daily"]["temperature_2m_min"][i]

precipitation = data["daily"]["precipitation_sum"][i]

forecast_text.append(f"El {date}: Max {max_temp}°C, Min {min_temp}°C, Lluvias: {precipitation} mm.")

return "\n".join(forecast_text)

return "No se pudo obtener el pronóstico del tiempo."

if __name__ == "__main__":

mcp.run()

Explicación Detallada: Las funciones asíncronas (async def) interactúan con la API de Open-Meteo usando httpx.AsyncClient. Los *type hints* guían al LLM sobre los argumentos esperados. Un LLM podría usar get_current_weather para responder a preguntas sobre el clima.

Cómo Ejecutar y Conectar:

Ejecuta el servidor FastMCP desde la terminal:

fastmcp run calculator_mcp.py

# o

fastmcp run weather_mcp.py

Un cliente MCP compatible (ej. Claude Desktop, IDEs integrados, plataformas de agentes) se conectará al servidor FastMCP (ej. localhost en un puerto específico o vía stdio) para descubrir y utilizar las herramientas expuestas.

6. Tu Ventaja Competitiva en 2026 con FastMCP

FastMCP proporciona una ventaja competitiva decisiva en 2026:

- Desarrollo Acelerado: Reduce el tiempo de desarrollo al estandarizar la integración de LLMs con lógica personalizada y sistemas externos.

- IA Más Capaz: Transforma LLMs en agentes dinámicos que pueden ejecutar lógica compleja, acceder a datos en tiempo real y automatizar tareas directamente desde scripts de Python.

- Innovación Sin Límites: Abre nuevas posibilidades para agentes de IA, sistemas de automatización inteligente y aplicaciones conversacionales que interactúan con el mundo digital.

- Preparación para el Futuro: Adopta un estándar abierto y agnóstico a la plataforma, garantizando la interoperabilidad con LLMs y clientes de IA futuros.

- Diferenciación: Permite crear soluciones de IA únicas y potentes que superan las capacidades de los modelos predeterminados.

7. Conclusión

El Protocolo de Contexto del Modelo (MCP), implementado a través de FastMCP, hace realidad la IA integrada y consciente del contexto utilizando Python. FastMCP simplifica la transformación de funciones de Python en herramientas dinámicas accesibles para la IA, superando las limitaciones de los LLMs aislados. El 2026 marca el año en que la integración entre código personalizado e IA se convierte en una oportunidad ilimitada. Explorar FastMCP permite construir la próxima generación de aplicaciones inteligentes y reactivas, poniendo el futuro de la IA conectada en manos de los desarrolladores.

Referencias:

- FastMCP Documentation: https://github.com/fastmcp/fastmcp

- Open-Meteo API: https://open-meteo.com/

- httpx Documentation: https://www.python-httpx.org/

- Conceptos de LLM Function Calling / Tool Use (ej. OpenAI, Anthropic, LangChain) sientan las bases conceptuales para la necesidad que MCP/FastMCP resuelve de forma estandarizada.

Share via: